מודל 3 השכבות: כיצד Claude מאבטח כלי AI בסיכון גבוה

מודל 3 השכבות: כיצד Claude מאבטח כלי AI בסיכון גבוה

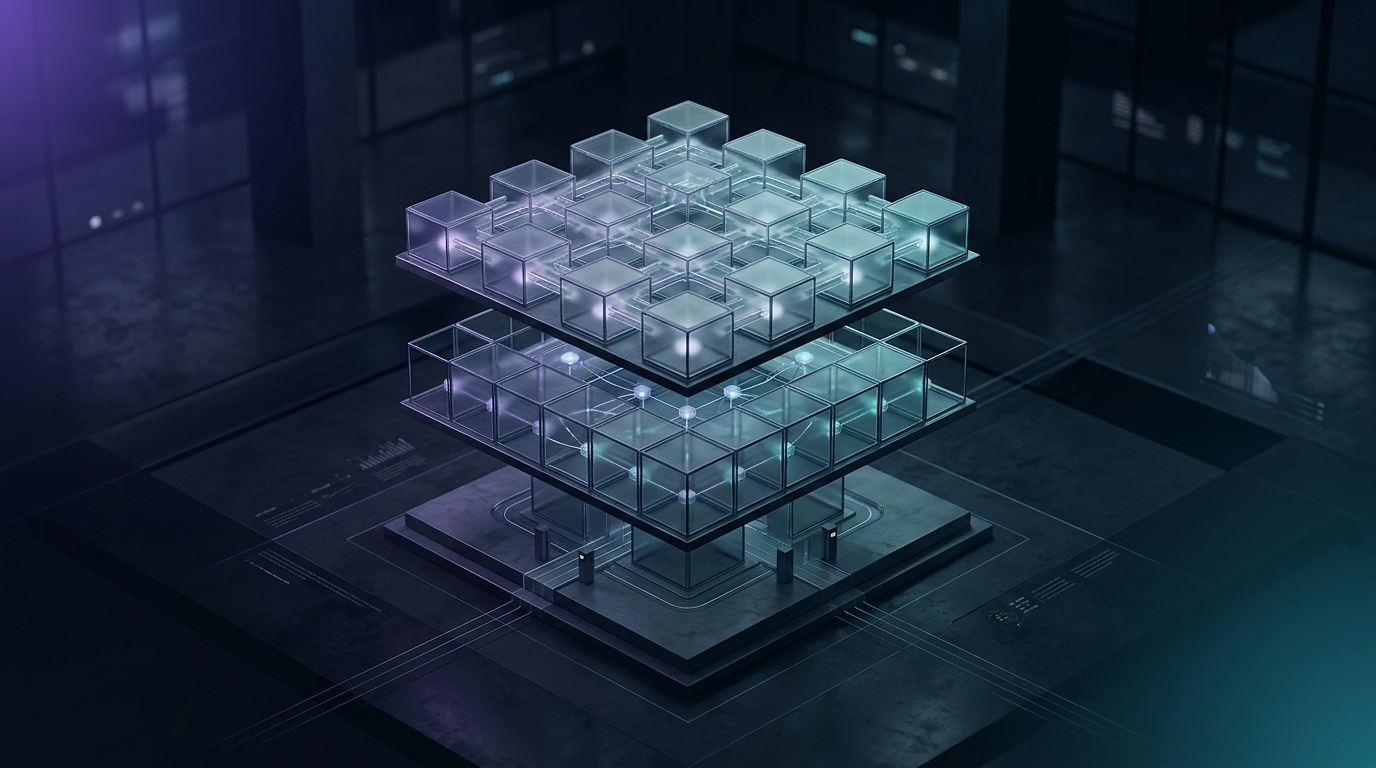

כדי לאבטח כלי AI בסיכון גבוה, יש לעבור מגישה של אבטחה בינארית (מותר/אסור) למודל אמון מדורג המפריד בין יכולות מובנות, תוספים חיצוניים ומיומנויות המוגדרות על ידי המשתמש. מודל זה מאפשר להפעיל כלים עוצמתיים כמו הרצת קוד (Bash) תחת מעטפת הגנה רב-שכבתית הכוללת ניטור בזמן אמת וסינון פקודות.

נקודות מפתח (Key Takeaways)

- מעבר מאבטחה בינארית למדורגת: לא כל כלי AI דורש את אותה רמת פיקוח; סיווג הכלים מאפשר גמישות לצד ביטחון.

- שלוש שכבות האמון: הבנה של ההבדל בין Built-in Tools, Plugins, ו-Skills היא קריטית לארכיטקטורת מערכת בטוחה.

- מקרה בוחן - Bash Tool: כיצד 18 מודולי אבטחה נפרדים מגנים על המערכת מפני פקודות הרסניות.

- יישום ארגוני: צעדים מעשיים להטמעת מודל אמון בתוך מערכות ה-AI של הארגון.

מדוע אבטחה בינארית כבר לא מספיקה לעידן ה-AI?

בעבר, אבטחת מידע התבססה על חומות אש והרשאות גישה פשוטות. בתחום ה-AI, הגישה הזו קורסת. אם נחסום לחלוטין גישה של מודל שפה (LLM) למערכות חיצוניות, נאבד את הערך העסקי שלו. אם נאפשר גישה חופשית, אנחנו חושפים את הארגון לסיכוני הזרקת פקודות (Prompt Injection) ודליפת מידע.

האתגר המרכזי הוא שסוכני AI פועלים בסביבה דינמית. הם מייצרים קוד בזמן אמת ומחליטים באילו כלים להשתמש כדי לפתור בעיה. לכן, עלינו לבנות מערכת שבה רמת הפיקוח תואמת את רמת הסיכון של הכלי הספציפי.

שלוש רמות האמון: המבנה הארכיטקטוני של Claude

Claude, מבית Anthropic, מציג גישה מתקדמת המחלקת את הכלים העומדים לרשות המודל לשלוש קטגוריות מרכזיות:

שכבה 1: Built-in Tools (כלים מובנים)

אלו הם כלים המהווים חלק בלתי נפרד מהמערכת. הם נהנים מרמת האמון הגבוהה ביותר מכיוון שהם נכתבו, נבדקו ועברו אופטימיזציה על ידי צוותי הפיתוח של המודל עצמו. דוגמה לכך היא יכולת ניתוח קבצים או חיפוש בסיסי. כלים אלו תמיד זמינים למודל והסיכון בהם נמוך יחסית.

שכבה 2: Plugins (תוספים)

תוספים הם כלים חיצוניים המחוברים למודל כדי להרחיב את יכולותיו (למשל, חיבור ל-CRM או למערכת ניהול פרויקטים). רמת האמון כאן היא בינונית. המערכת מאפשרת למשתמש או למנהל המערכת להשבית אותם בלחיצת כפתור. כאן נדרשת שכבת הגנה שבודקת את הקלט והפלט העוברים בין המודל לתוסף.

שכבה 3: User-defined Skills (מיומנויות משתמש)

זוהי השכבה בעלת הסיכון הגבוה ביותר. מדובר בכלים או פונקציות שהמשתמש הסופי מגדיר בעצמו. מכיוון שהקוד הזה לא עבר בדיקות אבטחה קפדניות, המערכת מתייחסת אליו בזהירות מרבית (Default-deny). כל פעולה בשכבה זו דורשת אישור מפורש או הרצה בתוך סביבת Sandbox מבודדת לחלוטין.

מקרה בוחן: אבטחת כלי ה-Bash באמצעות 18 מודולי הגנה

אחד הכלים העוצמתיים והמסוכנים ביותר שניתן לתת לסוכן AI הוא ה-Bash tool – היכולת להריץ פקודות ישירות בשורת הפקודה. פקודה אחת לא נכונה (כמו rm -rf /) יכולה למחוק שרת שלם.

במקום להסתמך רק על בידוד (Sandboxing), Claude משתמש בארכיטקטורה הכוללת 18 מודולי אבטחה נפרדים:

- סינון פקודות אסורות: רשימה שחורה של פקודות מסוכנות.

- זיהוי תבניות חשודות: שימוש בביטויים רגולריים (Regex) לזיהוי ניסיונות עקיפה.

- הגבלת משאבים: מניעת מצב שבו המודל מריץ תהליכים שצורכים את כל ה-CPU או הזיכרון.

- אישור אנושי לפעולות הרסניות: המערכת מזהה פקודות שיכולות לשנות נתונים ומחייבת לחיצה על כפתור אישור.

הגישה הזו מראה שניתן לאפשר יכולות קצה (High-utility) מבלי להתפשר על בטיחות, כל עוד משקיעים בפירוק מנגנון ההגנה למודולים קטנים וספציפיים.

LLM Implementation Guide

כיצד ארגונים יכולים ליישם מודל אמון מדורג?

אם אתם בונים סוכני AI פנים-ארגוניים, כדאי לאמץ את העקרונות הבאים:

- מיפוי כלים: רשמו את כל הכלים שה-AI שלכם יכול לגשת אליהם ודרגו אותם לפי רמת סיכון (נמוך, בינוני, גבוה).

- בידוד סביבות: ודאו שכלים בשכבה 3 רצים תמיד בתוך קונטיינרים מבודדים ללא גישה לרשת הארגונית.

- ניטור ובקרה (Observability): שמרו לוגים מפורטים של כל קריאה לכלי חיצוני. מי המודל שקרא לו? מה היה הקלט? ומה הייתה התוצאה?

סיכום

העתיד של ה-AI בארגונים תלוי ביכולת שלנו לתת למודלים "ידיים ורגליים" – כלומר, גישה לכלים. מודל האמון התלת-שכבתי מספק את המפה הנדרשת כדי לעשות זאת בבטחה. על ידי הפרדה בין סוגי הכלים ויישום הגנות ספציפיות כמו אלו שראינו בכלי ה-Bash, ניתן להפיק את המקסימום מהטכנולוגיה מבלי לסכן את הנכסים הדיגיטליים של החברה.

רוצים להטמיע סוכני AI מאובטחים בארגון שלכם? צרו קשר עם המומחים של Aniccai עוד היום.

שאלות ותשובות (FAQ)

ש: מהו מודל אמון מדורג ב-AI? ת: זוהי שיטה לסיווג כלי ה-AI לפי רמת הסיכון שלהם, כאשר לכל רמה יש מנגנוני הגנה ואישור שונים, במקום להחיל מדיניות אבטחה אחידה על הכל.

ש: מדוע כלי ה-Bash נחשב למסוכן כל כך? ת: מכיוון שהוא מאפשר למודל ה-AI לתקשר ישירות עם מערכת ההפעלה, מה שעלול להוביל למחיקת קבצים, שינוי הגדרות שרת או דליפת מידע אם לא מוגדרים לו גבולות ברורים.

ש: האם ניתן לסמוך על ה-AI שיאבטח את עצמו? ת: לא. אבטחה חייבת להיות מיושמת ברמת הארכיטקטורה החיצונית למודל (Guardrails), כפי שמודגם ב-18 מודולי האבטחה של Claude.

ש: איך מתחילים ליישם את זה בארגון קטן? ת: מתחילים בהגדרת "רשימה לבנה" של פקודות וכלים מותרים, ומוודאים שכל פעולה משמעותית דורשת אישור אנושי (Human-in-the-loop).

מאמרים קשורים

מדוע חיפוש וקטורי כבר לא מספיק למהפכת ה-AI?

גלו מדוע ענקיות הטכנולוגיה עוברות מחיפוש וקטורי פשוט לארכיטקטורות ידע מורכבות ואיך זה משפיע על אסטרטגיית ה-AI שלכם.

המקצועות שישרדו את ה-AI: איך להפוך לנכס שאי אפשר להחליף

האם המקצוע שלך בסכנה? גלו איך להפוך לנכס בלתי נפרד בעידן ה-AI דרך שיפור שיקול הדעת, אימוץ תהליכי עבודה אג'נטיים והתמקדות בערך אנושי ייחודי.

אשליית שיעורי הבית: מה שהמחשבון של שנות ה-70 מלמד אותנו על AI

שיעורי הבית המסורתיים מתו, וזה הדבר הכי טוב שקרה למערכת החינוך. גלו איך מהפכת המחשבונים משנות ה-70 משרטטת את הדרך לאימוץ נכון של AI בארגונים ובבתי ספר.